外观

Ollama安装与使用

Ollama

介绍

Ollama 是一个开源的本地大语言模型部署与管理工具,2023 年底应运而生,核心作用是简化各类开源大语言模型在本地设备的部署、运行与管理流程,无需复杂环境配置

- 提供 REST API 和 Python/JavaScript SDK,能轻松与 LangChain 等框架无缝集成,方便开发者将本地模型嵌入到自己的应用程序中。

- 自动检测 GPU 并启用加速,若无 GPU 也可使用 CPU 运行

- 丰富的模型兼容能力

安装Ollama

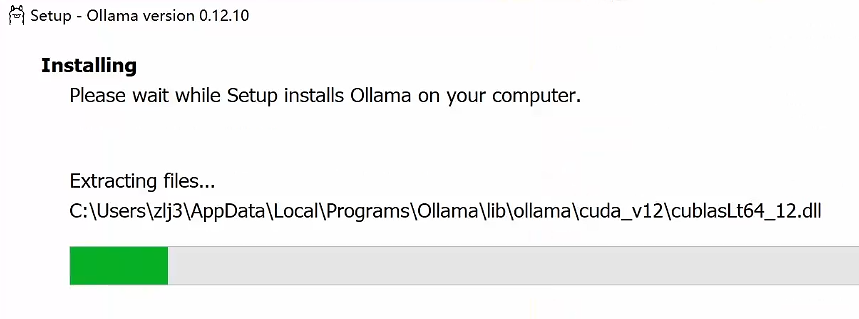

Ollama下载地址 。 文件大概1.2GB,可以使用下载工具提高速度。

安装方法一

- 下载后双击安装包,运行安装。默认安装在C盘的用户目录下。

安装方法二

- 通过下面方法指定安装位置。

- 进入安装包所在目录,打开CMD,输入下面命令

shell

OllamaSetup.exe /DIR="d:\some\location"安装成功后查看版本:打开CMD,输入下面命令查看Ollama版本

shell

ollama -v

# 看到版本信息表示安装成功

C:\Users\zlj3>ollama -v

ollama version is 0.12.10

# 查看其它命令

ollama -h设置Ollama

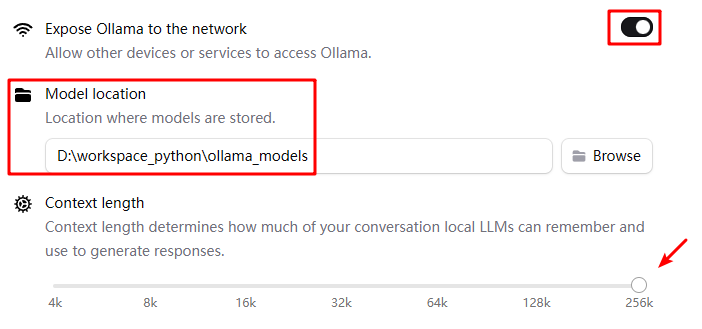

设置模型下载地址和网络访问

打开Ollama主界面——Settings,Model location选择模型保存位置

同时,打开“Expose Ollama to the network”

调整Context length:默认4K,如果调整为256K上下文,需要足够显存约16-24GB。

下载运行模型

下载并运行模型步骤

- 打开Ollama官网,选择模型。例如选择

deepseek-r1:1.5b,点击复制按钮 - 打开CMD,输入下面命令下载并运行模型

shell

ollama run deepseek-r1:1.5b- 等待下载完成,即可进行对话。

- 按CTRL+D退出

常用命令

shell

# 查看已下载的模型

ollama list

# 查看正在运行的模型

ollama ps

# 下载指定模型。下载速度一般,不支持断点续传,建议利用晚上时间下载,第二天查看下载结果

ollama pull codegeex4:latest

# 停止运行指定模型

ollama stop codegeex4:latest参考资料

调用Ollama

前提条件:下载并运行模型

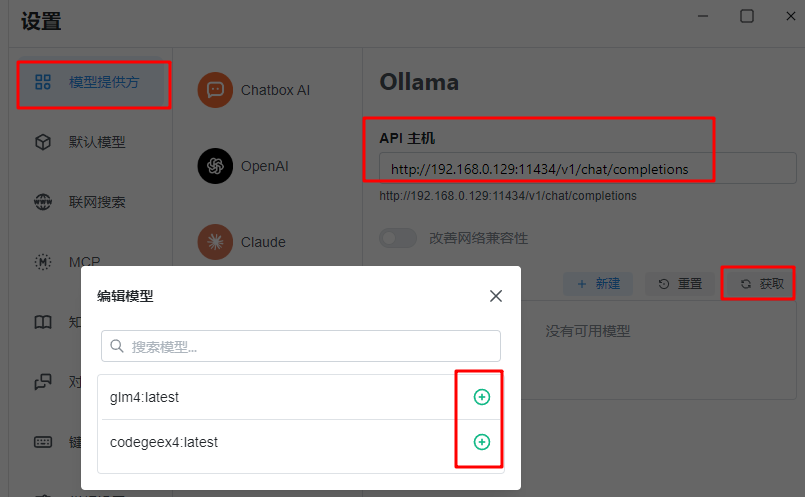

Chatbox调用

Chatbox 是一款开源跨全平台的 AI 聊天客户端。下载安装教程:《Chatbox安装与使用》

Chatbox 调用Ollama

- 设置——添加模型提供方——选择Ollama,填写运行Ollama主机的地址。例如:

http://127.0.0.1:11434/v1/chat/completions - 点击获取,看到模型列表后,点击模型的加号

- Chatbox主界面——选择模型,开始聊天

代码调用

安装 langchain

bash

pip install langchain代码调用

python

from langchain.chat_models import init_chat_model

# 连接到Ollama API

MODEL = "deepseek-r1:7b"

BASE_URL = "http://127.0.0.1:11434/v1"

chat_model = init_chat_model(model=MODEL, model_provider="openai", base_url=BASE_URL)

# # 非流式提问

# query = "你是?"

# response = chat_model.invoke(query)

# response.pretty_print()

# 流式提问

query = "你能做什么?"

for chunk in chat_model.stream(query):

print(chunk.text, end="", flush=True)输出结果示例

bash

<think>

</think>

作为一个通用领域的人工智能,我可以帮助您回答问题,提供信息,或者进行愉快的聊天。您不管有什么话题都可以找我聊聊~